keras的get_value运行越来越慢的解决方案

keras 深度学习框架中get_value函数运行越来越慢,内存消耗越来越大问题

问题描述

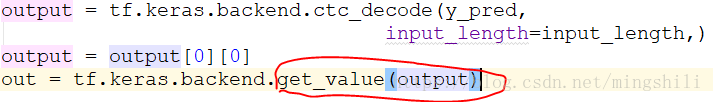

如上图所示,经过时间和内存消耗跟踪测试,发现是keras.backend.get_value() 函数导致的程序越来越慢,而且严重的造成内存泄露;

查看该函数内部实现,发现一个主要核心是x.eval(session=get_session()),该语句可能是导致内存泄露和运行慢的核心语句; 根据查看一些博文得到了运行得越来越慢的

原因:该x.eval函数会添加新的节点到tf的图中;而这也导致了tf的图越来越大,内存泄露;

解决方法

import tensorflow.keras.backend as K

def get_my_session(gpu_fraction=0.1):

'''Assume that you have 6GB of GPU memory and want to allocate ~2GB'''

num_threads = os.environ.get('OMP_NUM_THREADS')

gpu_options = tf.GPUOptions(per_process_gpu_memory_fraction=gpu_fraction)

if num_threads:

return tf.Session(config=tf.ConfigProto(

gpu_options=gpu_options, intra_op_parallelism_threads=num_threads))

else:

return tf.Session(config=tf.ConfigProto(gpu_options=gpu_options))

K.set_session(get_my_session())

如上图所示, 我在使用tensorflow之前(也就是该工程文件前面),对session进行自定义,然后用自定义的session设定keras.backend.set_session();

然后删除get_value() 函数,直接用get_value()中所使用的执行语句x.eval(session=get_my_session());这样这个添加节点导致内存泄露的核心语句x.eval()就使用的是该工程统一自定义session,然后用tf.reset_default_graph() 对图重置就可以了

即上图问题代码修改为:

output = ctc_decode(y_pred,input_length=input_length,) output = output[0][0] out = output.eval(session=get_my_session()) # 删除 K.get_value(out[0][0]) tf.reset_default_graph() # 然后重置tf图,这句很关键

这样就解决了get_value()导致的越来越慢的问题;

个人认为:这样可能就不会总是添加新的节点,导致tf图不断地无限变大;而是重复使用这一个自定义的节点。

补充:tensorflow与keras之间版本问题引起get_session问题解决办法

1.产生报错原因

import tensorflow.keras.backend as K

def __init__(self, **kwargs):

self.__dict__.update(self._defaults) # set up default values

self.__dict__.update(kwargs) # and update with user overrides

self.class_names = self._get_class()

self.anchors = self._get_anchors()

self.sess = K.get_session()

报错如下:

get_session is not available when using TensorFlow 2.0.

意思是 tf2.0 没有 get_session

2.解决方案1

import tensorflow.python.keras.backend as K sess = K.get_session()

3. 解决方案2

import tensorflow as tf sess = tf.compat.v1.keras.backend.get_session()

之前一直采用方案1 解决,感觉比较方便;但是解决方案1 有其它属性会丢失问题

比如AttributeError: module ‘keras.backend' has no attribute image_dim_ordering

所以建议大家采用方案2

以上为个人经验,希望能给大家一个参考,也希望大家多多支持猪先飞。

相关文章

在Keras中利用np.random.shuffle()打乱数据集实例

这篇文章主要介绍了在Keras中利用np.random.shuffle()打乱数据集实例,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-16解决在keras中使用model.save()函数保存模型失败的问题

这篇文章主要介绍了解决在keras中使用model.save()函数保存模型失败的问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-21- 这篇文章主要介绍了解决Keras 中加入lambda层无法正常载入模型问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-17

- 这篇文章主要介绍了keras.layer.input()用法说明,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-17

- 这篇文章主要介绍了keras的三种模型实现与区别说明,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-04

完美解决TensorFlow和Keras大数据量内存溢出的问题

这篇文章主要介绍了完美解决TensorFlow和Keras大数据量内存溢出的问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-04- 这篇文章主要介绍了利用keras使用神经网络预测销量操作,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-08

- 这篇文章主要介绍了使用keras实现孪生网络中的权值共享教程,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-11

- 这篇文章主要介绍了keras:model.compile损失函数的用法,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-02

- 这篇文章主要介绍了keras输出预测值和真实值方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-28

- 这篇文章主要介绍了keras实现基于孪生网络的图片相似度计算方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-12

- 这篇文章主要介绍了keras实现调用自己训练的模型,并去掉全连接层,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-10

- 今天小编就为大家分享一篇PyTorch和Keras计算模型参数的例子,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-04-30

- 这篇文章主要介绍了使用Keras预训练好的模型进行目标类别预测详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-28

- 这篇文章主要介绍了使用Keras画神经网络准确性图教程,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-16

- 这篇文章主要介绍了keras实现多GPU或指定GPU的使用介绍,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-18

Keras 在fit_generator训练方式中加入图像random_crop操作

这篇文章主要介绍了Keras 在fit_generator训练方式中加入图像random_crop操作,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-04- 本文主要利用U-Net网络结构实现了多类的语义分割,并展示了部分测试效果,希望对你有用!...2020-06-11

教你如何在pycharm中安装opencv,tensorflow,keras

今天通过本教程教大家如何在pycharm中安装opencv,tensorflow,keras,本文分步骤给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-08-09- 这篇文章主要介绍了keras 自定义loss层+接受输入实例,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-06-29