Docker Compose一键ELK部署的方法实现

安装

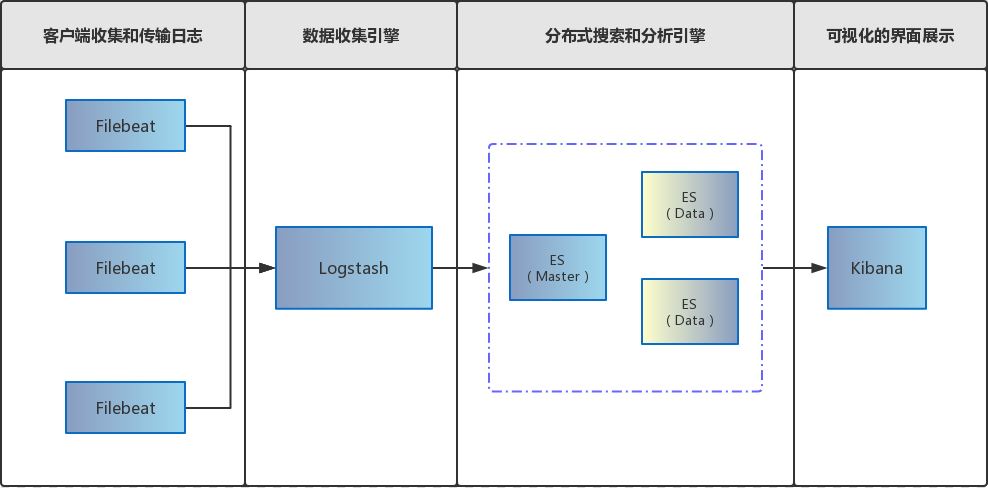

Filebeat 已经完全替代了 Logstash-Forwarder 成为新一代的日志采集器,因为它更加轻量、安全。基于 Filebeat + ELK 的部署方案架构图如下:

软件版本:

| 服务 | 版本 | 说明 |

|---|---|---|

| CentOS | 7.6 | |

| Docker | 18.09.5 | |

| Docker Compose | 1.25.0 | |

| ELK | 7.5.1 | |

| Filebeat | 7.5.1 |

docker-compose 文件

version: "3" services: es-master: container_name: es-master hostname: es-master image: elasticsearch:7.5.1 restart: always ports: - 9200:9200 - 9300:9300 volumes: - ./elasticsearch/master/conf/es-master.yml:/usr/share/elasticsearch/config/elasticsearch.yml - ./elasticsearch/master/data:/usr/share/elasticsearch/data - ./elasticsearch/master/logs:/usr/share/elasticsearch/logs environment: - "ES_JAVA_OPTS=-Xms512m -Xmx512m" es-slave1: container_name: es-slave1 image: elasticsearch:7.5.1 restart: always ports: - 9201:9200 - 9301:9300 volumes: - ./elasticsearch/slave1/conf/es-slave1.yml:/usr/share/elasticsearch/config/elasticsearch.yml - ./elasticsearch/slave1/data:/usr/share/elasticsearch/data - ./elasticsearch/slave1/logs:/usr/share/elasticsearch/logs environment: - "ES_JAVA_OPTS=-Xms512m -Xmx512m" es-slave2: container_name: es-slave2 image: elasticsearch:7.5.1 restart: always ports: - 9202:9200 - 9302:9300 volumes: - ./elasticsearch/slave2/conf/es-slave2.yml:/usr/share/elasticsearch/config/elasticsearch.yml - ./elasticsearch/slave2/data:/usr/share/elasticsearch/data - ./elasticsearch/slave2/logs:/usr/share/elasticsearch/logs environment: - "ES_JAVA_OPTS=-Xms512m -Xmx512m" kibana: container_name: kibana hostname: kibana image: kibana:7.5.1 restart: always ports: - 5601:5601 volumes: - ./kibana/conf/kibana.yml:/usr/share/kibana/config/kibana.yml environment: - elasticsearch.hosts=http://es-master:9200 depends_on: - es-master - es-slave1 - es-slave2 # filebeat: # # 容器名称 # container_name: filebeat # # 主机名称 # hostname: filebeat # # 镜像 # image: docker.elastic.co/beats/filebeat:7.5.1 # # 重启机制 # restart: always # # 持久化挂载 # volumes: # - ./filebeat/conf/filebeat.yml:/usr/share/filebeat/filebeat.yml # # 映射到容器中[作为数据源] # - ./logs:/home/project/spring-boot-elasticsearch/logs # - ./filebeat/logs:/usr/share/filebeat/logs # - ./filebeat/data:/usr/share/filebeat/data # # 将指定容器连接到当前连接,可以设置别名,避免ip方式导致的容器重启动态改变的无法连接情况 # links: # - logstash # # 依赖服务[可无] # depends_on: # - es-master # - es-slave1 # - es-slave2 logstash: container_name: logstash hostname: logstash image: logstash:7.5.1 command: logstash -f ./conf/logstash-filebeat.conf restart: always volumes: # 映射到容器中 - ./logstash/conf/logstash-filebeat.conf:/usr/share/logstash/conf/logstash-filebeat.conf - ./logstash/ssl:/usr/share/logstash/ssl environment: - elasticsearch.hosts=http://es-master:9200 # 解决logstash监控连接报错 - xpack.monitoring.elasticsearch.hosts=http://es-master:9200 ports: - 5044:5044 depends_on: - es-master - es-slave1 - es-slave2

这里把 Filebeat 给注释掉了,打算在各个需要搜集日志的服务器上面单独部署 Filebeat。

记得把 Elasticsearch 的 data 和 logs 设置

chmod 777

es-master.yml

# 集群名称 cluster.name: es-cluster # 节点名称 node.name: es-master # 是否可以成为master节点 node.master: true # 是否允许该节点存储数据,默认开启 node.data: false # 网络绑定 network.host: 0.0.0.0 # 设置对外服务的http端口 http.port: 9200 # 设置节点间交互的tcp端口 transport.port: 9300 # 集群发现 discovery.seed_hosts: - es-master - es-slave1 - es-slave2 # 手动指定可以成为 mater 的所有节点的 name 或者 ip,这些配置将会在第一次选举中进行计算 cluster.initial_master_nodes: - es-master # 支持跨域访问 http.cors.enabled: true http.cors.allow-origin: "*" # 安全认证 xpack.security.enabled: false #http.cors.allow-headers: "Authorization"

es-slave1.yml

# 集群名称 cluster.name: es-cluster # 节点名称 node.name: es-slave1 # 是否可以成为master节点 node.master: true # 是否允许该节点存储数据,默认开启 node.data: true # 网络绑定 network.host: 0.0.0.0 # 设置对外服务的http端口 http.port: 9201 # 设置节点间交互的tcp端口 #transport.port: 9301 # 集群发现 discovery.seed_hosts: - es-master - es-slave1 - es-slave2 # 手动指定可以成为 mater 的所有节点的 name 或者 ip,这些配置将会在第一次选举中进行计算 cluster.initial_master_nodes: - es-master # 支持跨域访问 http.cors.enabled: true http.cors.allow-origin: "*" # 安全认证 xpack.security.enabled: false #http.cors.allow-headers: "Authorization"

es-slave2.yml

# 集群名称 cluster.name: es-cluster # 节点名称 node.name: es-slave2 # 是否可以成为master节点 node.master: true # 是否允许该节点存储数据,默认开启 node.data: true # 网络绑定 network.host: 0.0.0.0 # 设置对外服务的http端口 http.port: 9202 # 设置节点间交互的tcp端口 #transport.port: 9302 # 集群发现 discovery.seed_hosts: - es-master - es-slave1 - es-slave2 # 手动指定可以成为 mater 的所有节点的 name 或者 ip,这些配置将会在第一次选举中进行计算 cluster.initial_master_nodes: - es-master # 支持跨域访问 http.cors.enabled: true http.cors.allow-origin: "*" # 安全认证 xpack.security.enabled: false #http.cors.allow-headers: "Authorization"

logstash-filebeat.conf

input {

# 来源beats

beats {

# 端口

port => "5044"

ssl_certificate_authorities => ["/usr/share/logstash/ssl/ca.crt"]

ssl_certificate => "/usr/share/logstash/ssl/server.crt"

ssl_key => "/usr/share/logstash/ssl/server.key"

ssl_verify_mode => "force_peer"

}

}

# 分析、过滤插件,可以多个

filter {

grok {

match => { "message" => "%{COMBINEDAPACHELOG}"}

}

geoip {

source => "clientip"

}

}

output {

# 选择elasticsearch

elasticsearch {

hosts => ["http://es-master:9200"]

index => "%{[fields][service]}-%{[@metadata][version]}-%{+YYYY.MM.dd}"

}

}

filebeat.yml

filebeat.inputs:

- type: log

enabled: true

paths:

# 当前目录下的所有.log文件

- /root/tmp/logs/*.log

fields:

service: "our31-java"

multiline.pattern: ^\[

multiline.negate: true

multiline.match: after

- type: log

enabled: true

paths:

# 当前目录下的所有.log文件

- /root/tmp/log/*.log

fields:

service: "our31-nginx"

filebeat.config.modules:

path: ${path.config}/modules.d/*.yml

reload.enabled: false

# setup.template.settings:

# index.number_of_shards: 1

# setup.dashboards.enabled: false

# setup.kibana:

# host: "http://localhost:5601"

# 不直接传输至ES

#output.elasticsearch:

# hosts: ["http://es-master:9200"]

# index: "filebeat-%{[beat.version]}-%{+yyyy.MM.dd}"

setup.ilm.enabled: false

output.logstash:

hosts: ["logstash.server.com:5044"]

# Optional SSL. By default is off.

# List of root certificates for HTTPS server verifications

ssl.certificate_authorities: "./ssl/ca.crt"

# Certificate for SSL client authentication

ssl.certificate: "./ssl/client.crt"

# Client Certificate Key

ssl.key: "./ssl/client.key"

# processors:

# - add_host_metadata: ~

# - add_cloud_metadata: ~

注意

生成证书,配置 SSL,让 Filebeat 与 Logstash 之间建立 SSL。

#生成ca私钥 openssl genrsa 2048 > ca.key #使用ca私钥建立ca证书 openssl req -new -x509 -nodes -key ca.key -subj /CN=elkCA\ CA/OU=Development\ group/O=HomeIT\ SIA/DC=elk/DC=com > ca.crt #生成服务器csr证书请求文件 openssl req -newkey rsa:2048 -nodes -keyout server.key -subj /CN=logstash.server.com/OU=Development\ group/O=Home\ SIA/DC=elk/DC=com > server.csr #使用ca证书与私钥签发服务器证书 openssl x509 -req -in server.csr -CA ca.crt -CAkey ca.key -set_serial 01 > server.crt #生成客户端csr证书请求文件 openssl req -newkey rsa:2048 -nodes -keyout client.key -subj /CN=filebeat.client.com/OU=Development\ group/O=Home\ SIA/DC=elk/DC=com > client.csr #使用ca证书与私钥签发客户端证书 openssl x509 -req -in client.csr -CA ca.crt -CAkey ca.key -set_serial 01 > client.crt

证书记得放到对应的文件夹中。

Filebeat 中 output.logstash.hosts 配置的域名要与证书相符。

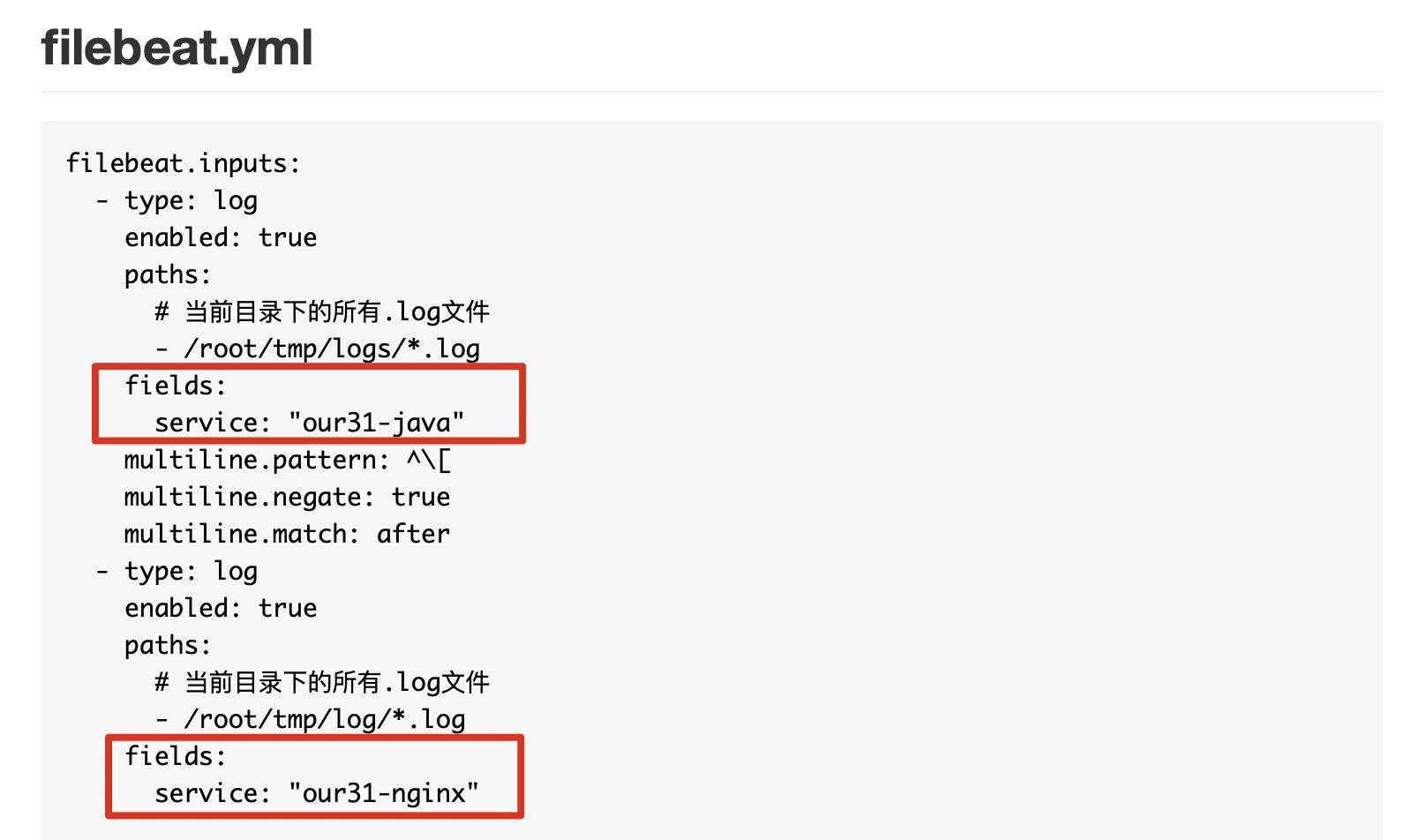

根据不同服务器、不同服务、不同日期动态生成索引

上面的这张图片中,加上了一些自定义属性,这些属性会传递到 Logstash 中,Logstash 会拿到这些属性动态的向 Elasticsearch 中创建索引,如下图:

详细介绍看官方文档,metadata,动态索引生成。

这里本来想使用 indices 来动态生成索引,但是根据官方配置,并没有成功,哪位兄弟知道可以告知下为什么。

利用 Nginx Http Basic Authorization 让 Kibana 需要登录

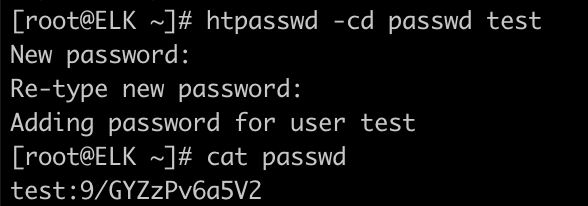

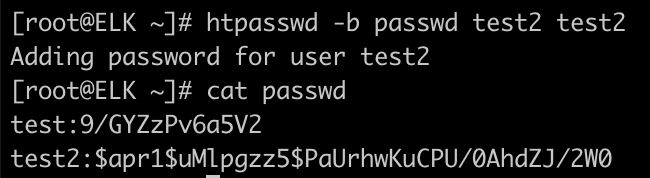

先使用工具 htpasswd 生成用户信息

$ yum -y install httpd-tools

创建新密码文件

追加用户信息:

最后配置好 Nginx 即可:

server {

......

auth_basic "Kibana Auth";

auth_basic_user_file /usr/local/nginx/pwd/kibana/passwd;

......

}

单独启动 Filebeat 的方式

$ nohup ./filebeat 2>&1 &

启动 Docker Compose

在 docker-compose.yml 所在目录执行:

$ docker-compose up --build -d

到此这篇关于Docker Compose一键ELK部署的方法实现的文章就介绍到这了,更多相关Docker Compose ELK部署内容请搜索猪先飞以前的文章或继续浏览下面的相关文章希望大家以后多多支持猪先飞!

相关文章

- 这篇文章主要介绍了zabbix v3.0安装部署全过程,文中通过一步步的步骤和图文介绍的非常详细,相信对大家具有一定的参考价值,需要的朋友们下面来一起看看吧。...2021-05-07

- 以下就是部署PHP时的4个配置修改说明,大家一个一个进行学习研究。1、short_open_tag 是什么呢? 决定是否允许使用代码开始标志的缩写形式(<? ?> )。如果要和 XML 结合使用PHP,可以禁用此选项以便于嵌入使用<?x...2015-10-21

浅谈Docker-compose中的depends_on顺序的问题解决

本文主要介绍了浅谈Docker-compose中的depends_on顺序的问题解决,文中通过示例代码介绍的非常详细,具有一定的参考价值,感兴趣的小伙伴们可以参考一下...2021-11-03docker 启动elasticsearch镜像,挂载目录后报错的解决

这篇文章主要介绍了docker 启动 elasticsearch镜像,挂载目录后报错的解决,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-11-20- 这篇文章主要介绍了教你如何用Jenkins自动化部署项目(从零到搭建完成),文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2020-10-08

解决Docker中的error during connect异常情况

这篇文章主要介绍了解决Docker中的error during connect异常情况,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-11-22- 这篇文章主要介绍了JS中的compose函数和pipe函数用法,想深入了解Javascript的同学,可以参考下...2021-04-27

Jenkins+tomcat自动发布的热部署/重启及遇到的问题解决办法(推荐)

这篇文章主要介绍了Jenkins+tomcat自动发布的热部署/重启及遇到的问题解决办法,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2020-07-10- 这篇文章主要介绍了docker部署confluence的完整步骤,这里的镜像并不是小编自己写的是基于他人打包的文中有详细介绍,需要的朋友可以参考下...2021-06-11

- 这篇文章主要介绍了解决docker挂载的目录无法读写问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-19

- 周一今天给大家分享shell脚本多实例部署nginx的详细教程,文章通过实例代码脚本给大家详细介绍,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧...2021-10-26

- 这篇文章主要介绍了docker swarm外部验证负载均衡时不生效的问题,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-04-27

教你使用Portainer管理多台Docker容器环境的方法

这篇文章主要介绍了Portainer管理多台Docker容器环境,本文给大家介绍的非常详细,包括环境准备及管理docker的详细过程,需要的朋友可以参考下...2021-11-11使用Maven 搭建 Spring MVC 本地部署Tomcat的详细教程

这篇文章主要介绍了使用Maven 搭建 Spring MVC 本地部署Tomcat,本文通过图文并茂的形式给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-08-16- 这篇文章主要介绍了docker端口映射及外部无法访问问题,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2021-01-19

Docker 解决openjdk容器里无法使用JDK的jmap等命令问题

这篇文章主要介绍了Docker 解决openjdk容器里无法使用JDK的jmap等命令问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-12-04- 这篇文章主要介绍了Tomcat首次部署web项目流程图解,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友可以参考下...2020-12-11

使用rpm安装指定版本docker(1.12.6)的详细步骤

为了防止安装高版本的docker引发的错误,需要安装1.12.6版本的docker,下面小编给大家带来了使用rpm安装指定版本的docker(1.12.6)的步骤,感兴趣的朋友一起看看吧...2021-08-11idea配置springboot热部署终极解决办法(解决热部署失效问题)

这篇文章主要介绍了idea配置springboot热部署终极解决办法(解决热部署失效问题),本文通过实例代码给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧...2020-07-22- 通过本文可以帮助大家快速学习Docker安装ElasticSearch的过程,本文通过图文并茂的形式给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友参考下吧...2021-08-31